EMOTION:通过上下文学习为人形机器人生成富有表现力的动作序列

2025年03月15日

导读

在日常人际交流中,面部表情、手势和身体动作等非语言表达方式对有效沟通至关重要。因此,将肢体语言等融入机器人的交互系统,对于促进更自然、更愉悦的人机互动体验意义重大。

现有的机器人技术虽然已实现从预定义动作序列到基于传感器的动态行为等不同策略,但通常在现实互动中缺乏适应性,难以模仿人类非语言交流的多样性和细微差别。

日前,苹果公司(Apple)的研究团队提出了一种新框架EMOTION以改善机器人的非语言交流能力。基于大语言模型(LLMs)和视觉-语言模型(VLMs)的上下文学习能力,该框架可以使机器人生成富有表现力、适应社交情境的手势动作序列。

实验结果表明,部署EMOTION和EMOTION++的太阳集团见好就收9728GR-1人形机器人所展现的手势动作,在自然程度和可理解性方面能够达到甚至超越真人示范的水平。

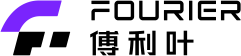

EMOTION框架

EMOTION以用户语言指令和/或机器人观测图像作为输入内容,输出一组连续值动作序列。同时引入人类反馈机制(EMOTION++),优化并生成新的动作序列。最终,通过逆运动学、轨迹插值和轨迹跟踪,由人形机器人执行动作序列。

EMOTION框架概览

输入内容提供了机器人需要响应的社交情境,通过第一个VLM或LLM的处理,基于链式思维提示,得到社交情境分析及对应手势。例如,把一张某人正在白板上解数学题的图片作为输入,通过提示引导大语言模型描述所看到的内容,并仅通过手势做出回应。对此的社交情境分析可能是“我看到一个人在白板上解出了一道复杂的数学题。我应该为这一成就表达认可和鼓励”,对应的手势可能是“点赞”。此外,输入也可以是简单的语言指令,例如“仅使用手势表达困惑”。

研究团队使用左右手笛卡尔坐标系位置(3D)、欧拉角表示的方向(3D)、每根手指的开合状态(5D)这六种参数来描述机器人的动作序列表示,同时使用Vision Pro采集人类示范数据,以支持后续的动作序列生成任务。

动作序列表示

将得到的手势作为第二个LLM的输入,并结合坐标定义、动作序列表示、链式思维提示和人类示范数据,生成动作序列。将当前动作序列和自然语言格式的人类反馈作为第三个LLM的输入,最终输出优化后的动作序列。

这一过程的关键在于动态生成。不同于传统的预设手势,EMOTION利用大型语言模型根据每次交互实时生成最适合的手势,使机器人不仅仅是简单的“执行者”,而是能够进行富有表现力对话的“智能体”。

此外,人类反馈是提升机器人交互质量的关键因素。通过引入EMOTION++版本,机器人在与人类互动中学习并调整自身表现。这种持续优化使机器人生成的动作更符合人类的期望和社交习惯,从而提升了机器人在互动中的自然性和可理解度。

研究实验

研究问题与假设

为了评估EMOTION方法的有效性,研究团队围绕生成动作的感知效果,提出两个研究问题和两个假设:

问题1:与真人示范手势相比,EMOTION生成手势的感知效果如何?

问题2:相比于EMOTION,添加人类反馈的EMOTION++是否、以及在何种程度上提升了手势的感知效果?

假设1:EMOTION生成的手势在感知上不会与人类手势表现出显著差异。

假设2:EMOTION++生成的手势比EMOTION更加自然且易于理解。

实验准备

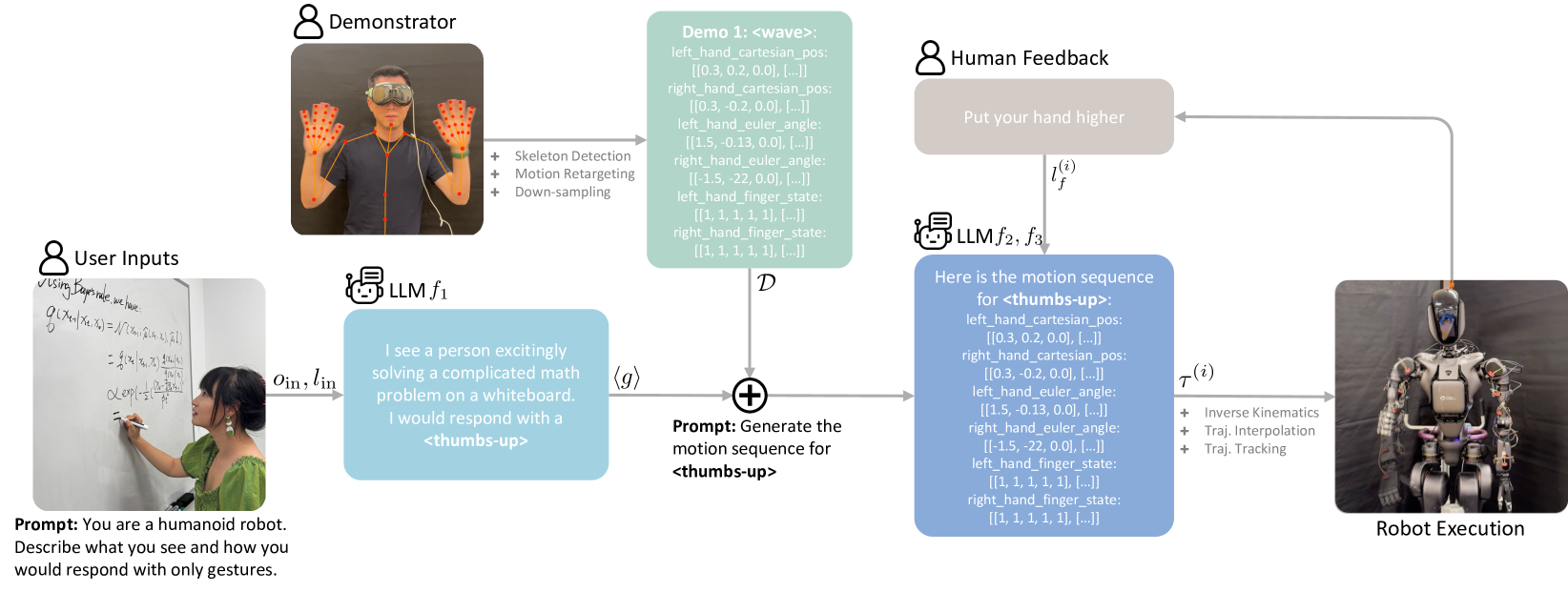

基于非语言交流的既定分类方法,本实验共收集10种手势用于部署和评估,涵盖四类表达性手势:象征性手势、说明性手势、情感表达手势和调节性手势。这些手势来自模型生成或真人示范,由研究人员在机器人仿真平台上进行验证和筛选,再根据人类反馈进行最多5轮优化,直至仿真行为达到预期效果,最后部署到太阳集团见好就收9728GR-1人形机器人上进行视频录制,用于评估和比较。

10种机器人表达性手势

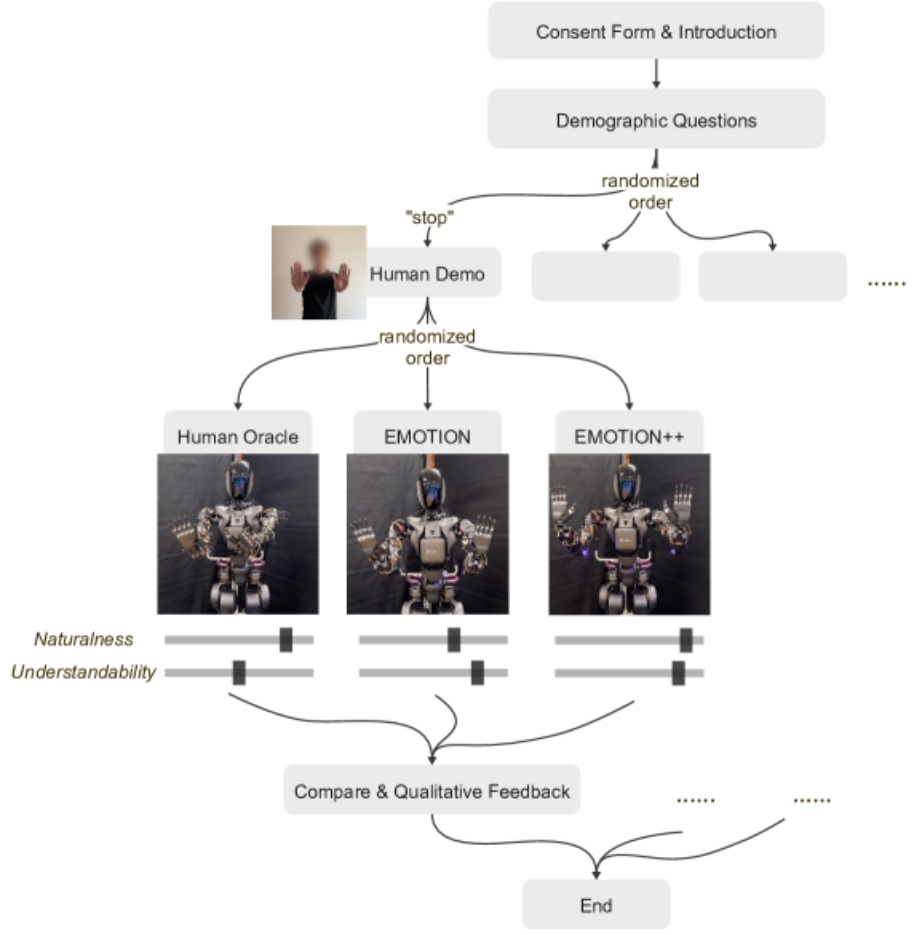

实验设计

本实验招募了30名参与者,收集他们的人口统计数据,包括性别、年龄、种族、对机器人的总体态度,以及日常使用手势进行表达的情况。经过筛选,最终获得22份有效数据。这些数据被纳入分析过程,以探讨对实验结果的潜在影响。

每位参与者都会观看随机排列播放的三个视频,即真人示范手势、EMOTION生成手势和EMOTION++生成手势。随后参与者使用7分制李克特量表,对手势的自然程度和可理解性进行自评,并解释评分依据,提供更深入的见解。为确保实验条件一致,研究团队事先提供了一段由真人演示的相同手势视频及相关描述,帮助参与者理解每个手势的意义。

实验流程示意图

实验结果

使用单因素方差分析对自然程度和可理解性评分进行统计检验,结果表明:

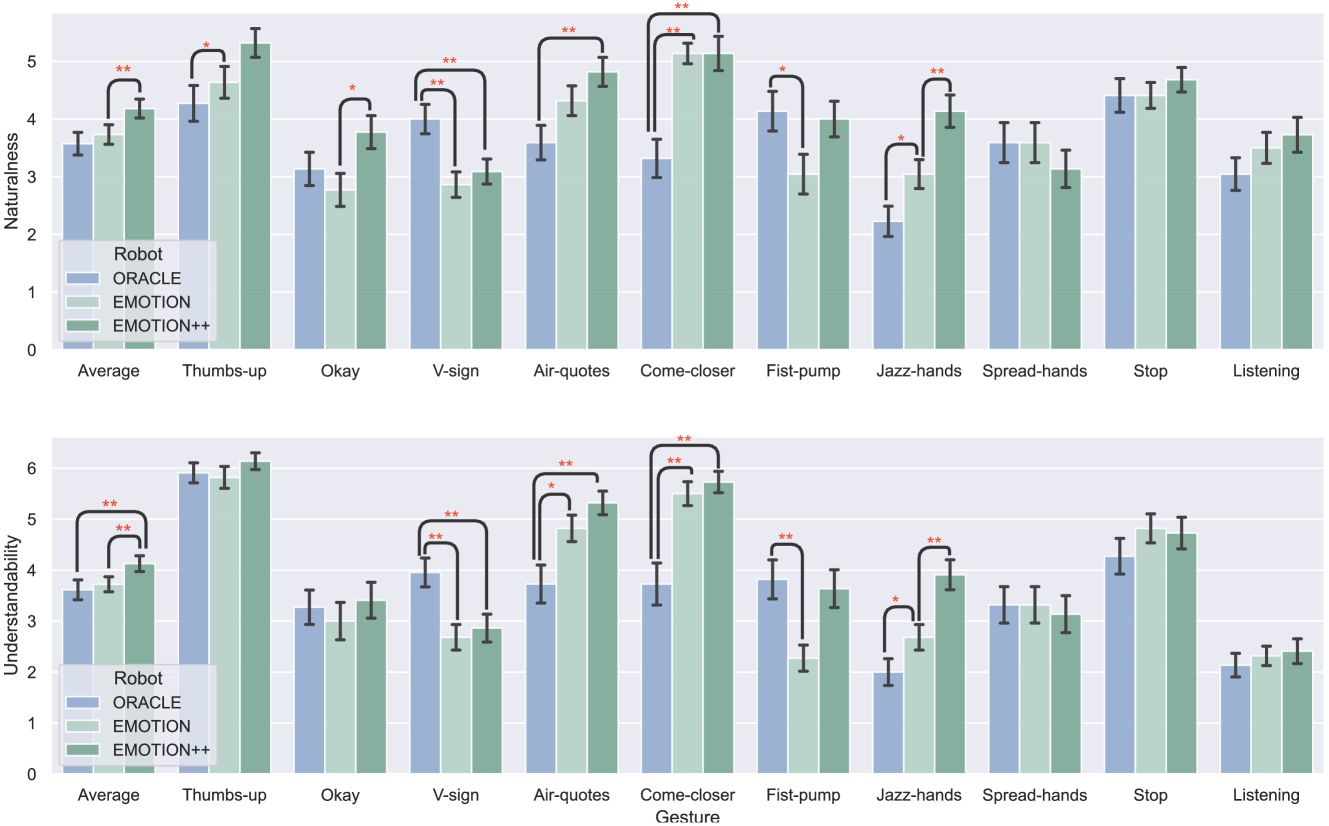

- EMOTION生成的手势在自然程度(p=0.267)和可理解性(p=0.528)上与真人示范手势没有显著的统计学差异,即EMOTION 生成的手势在整体上能达到与真人示范相当的效果,假设1成立。

- EMOTION++在自然程度(p=0.0014)和可理解性(p=0.019)上都显著优于EMOTION,即融合人类反馈的EMOTION++生成的手势比EMOTION更加自然和易于理解,假设2成立。

- EMOTION++的可理解性(p=0.003)显著高于真人示范,自然程度评分更高但未达到统计学显著性,即EMOTION++在许多手势上能达到甚至优于真人示范水平。

对机器人表达性行为的自然程度和可理解性评分进行单因素方差分析,判断具有统计学意义,*表示p<0.05(显著差异),**表示p<0.01(极显著差异)

使用线性回归分析研究参与者背景与手势可理解性/自然程度评分之间的关系,结果表明,参与者共情能力越强,越能理解机器人的动作,并认为其更自然;参与者年龄越大,认为机器人的动作越不自然;其他因素与评分之间无显著相关性。

为了深入探究EMOTION和EMOTION++与真人示范在不同手势上的感知差异,研究人员对参与者提供的评分理由进行质性分析,提炼出三个主题和十二个子主题。结果表明,人类反馈在提高手势的清晰度和自然性方面表现出色,EMOTION++显著优化了手部位置、运动轨迹和手势自然性,不仅优于EMOTION,还在许多情况下与真人手势媲美,但某些手势仍可能因上下文不同而被误解。

结论与建议

本研究提出了基于大语言模型的框架EMOTION和EMOTION++,用于生成人形机器人的表达性手势。实验结果支持了利用大模型增强人形机器人表达能力的有效性,以及用自然语言反馈优化机器人手势的可行性,但在计算效率和轨迹可行性方面仍需进一步优化。

此外,本研究还为人形机器人的手势表达提供了设计建议,包括手部位置、运动轨迹优化、手指姿态和时序协调等关键变量。在未来工作中需要改进硬件限制、计算时间过长、人为干预引入的偏差等问题,并纳入用户背景变量,深入探讨不同人群对机器人生成手势的感知差异。

论文链接:https://arxiv.org/abs/2410.23234

太阳集团见好就收9728支持并推动具身智能的研究探索,通过与全球最头部的科技公司和顶尖科研院校开展交流与合作,加速人形机器人技术的创新与应用,促进AI与物理世界的融合发展。

Contact Us

生态合作:generalrobot@fftai.com

人才招聘:job@fftai.com